Ci siamo. Come io e (pochi) altri del settore evidenziamo da mesi, l’impossibilità di avere una AI “affidabile” con gli attuali metodi di sviluppo e addestramento sarà sempre più evidente, proprio al crescere della complessità dei contesti in cui gli LLM vengono collocati e delle metodologie di “potenziamento” cui sono sempre di più sottoposti.

Anthropic, infatti, ha sottolineato la necessità che i principali laboratori di intelligenza artificiale sviluppino un meccanismo coordinato e verificabile per rallentare o sospendere temporaneamente lo sviluppo dei modelli più avanzati qualora emergano rischi difficili da gestire.

L’azienda evidenzia in particolare il potenziale pericolo dei sistemi capaci di migliorare autonomamente i propri successori, uno scenario che potrebbe aumentare la difficoltà di monitorare, controllare e allineare l’AI agli obiettivi umani.

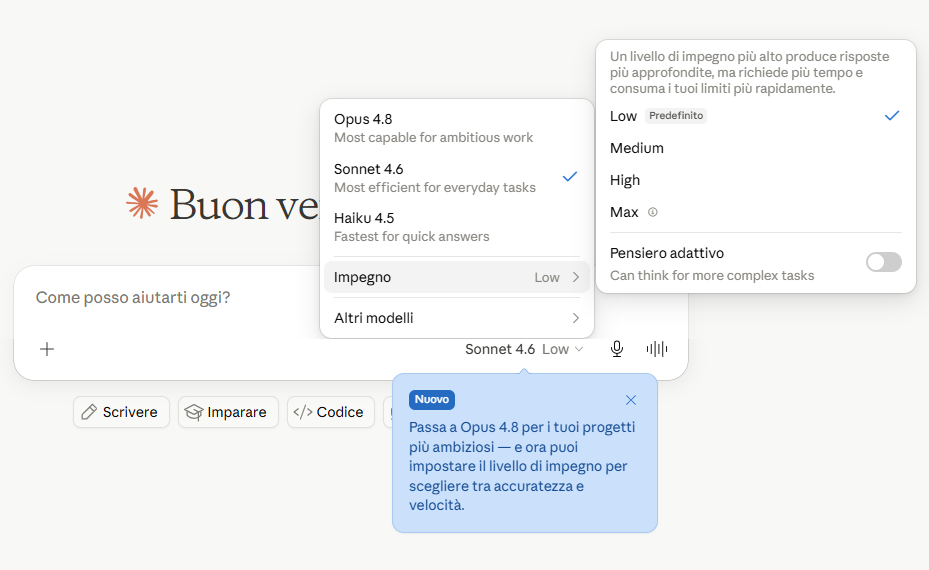

A sostegno dell’accelerazione tecnologica in corso, Anthropic ha rivelato che oltre l’80% del codice integrato nel proprio software a maggio è stato scritto da Claude. Secondo la società, una pausa efficace richiederebbe la collaborazione tra più laboratori di frontiera, criteri condivisi per attivarla o revocarla e un sistema di supervisione credibile.

Nei prossimi mesi, l’Anthropic Institute promuoverà confronti tra ricercatori, aziende, decisori politici e organizzazioni della società civile per definire possibili modelli di coordinamento e gestione del rischio.

Per approfondire: